Apple Intelligence: «AI for the rest of us»

Neben einer Vielzahl an Neuerungen in den kommenden Generationen von macOS, iOS, iPadOS, watchOS, tvOS, visionOS und Co. hat Apple anlässlich der heutigen WWDC24-Keynote auch viele neue AI-basierte Funktionen für das Mac-, das iPad- und das iPhone-Betriebssystem angekündigt.

Publireportage für CHF 420.– Werbung auf macprime

Inhaltsverzeichnis

«Apple Intelligence»

Persönlicher Kontext als Basis für Apple Intelligence

Datenschutz und Privatsphäre

Sichere Apple-Server: «Private Cloud Compute»

Viele Apple-Intelligence-basierte Funktionen

«AI mit Weltwissen» dank ChatGPT-Integration

Im Zuge des derzeit herrschenden AI-Wahns hat auch Apple eine ganze Palette an Neuerungen für die kommenden Betriebssysteme angekündigt, die auf künstlicher Intelligenz beruhen. Apple unterscheidet dabei zwischen zwei Welten – AI mit persönlichem Kontext und AI für «Weltwissen». Das Unternehmen fasst seine AI-Ambitionen unter der Bezeichnung «Apple Intelligence» zusammen.

Wie Apple-CEO Tim Cook während der Keynote sagte, habe sein Unternehmen beim Entwickeln der neuen AI-Funktionen stark darauf fokussiert, dass diese Neuerungen die Grundsätze widerspiegeln, «die den Kern unserer Produkte bilden» – dazu gehöre eine hohe Leistungsfähigkeit, «um bei den Dingen zu helfen, die einem am wichtigsten sind»; die Funktionen müssen «intuitiv und einfach zu bedienen» und auch «tief in die Produkterfahrungen integriert» sein. Am wichtigsten, so Cook, sei aber, dass sie «jemanden versteht und im persönlichen Kontext verankert ist» – sei es in der persönlichen Routine, den eigenen Beziehungen, der eigenen Kommunikation und vielem mehr. «Und natürlich muss die Privatsphäre von Grund auf gewährleistet sein.» Das sei alles «mehr als ‹Artificial Intelligence (künstliche Intelligenz)›, das ist vielmehr ‹Personal Intelligence (Persönliche Intelligenz)›», so Cook. Der CEO des Mac-Herstellers bezeichnet es sogar als «The Next Big Step (der nächste grosse Schritt)» für Apple.

«Apple Intelligence»

Apples Software-Chef Craig Federighi leitete in die Vorstellung von Apple Intelligence, dass es bereits einige sehr eindrucksvolle Chat-Tools gebe, die mit «Weltwissen» eine Grosszahl an Aufgaben erledigen können. Ebendiese Werkzeuge würden aber sehr wenig über die Anwenderin oder den Anwender wissen – oder über deren Bedürfnisse. Mit den im Herbst erscheinenden macOS 15, iPadOS 18 und iOS 18 bringe Apple deshalb «eine Intelligenz, die Sie versteht».

Apple Intelligence sei ein persönliches Intelligenz-System, das «leistungsstarke generative Modelle direkt ins Herz eines iPhone, iPad und Mac integriert», so Federighi weiter. Es nutze den persönlichen Kontext, um der Anwenderin oder dem Anwender «jene Informationen zu liefern, die für Sie am hilfreichsten und relevantesten sind». Dabei sei die persönliche Privatsphäre «bei jedem Schritt» geschützt. Und Apple Intelligence sei «tief in unsere Plattformen und in die Apps integriert, auf die Sie sich verlassen, um zu kommunizieren, zu arbeiten und sich auszudrücken».

Auch Apples Artificial Intelligence (künstliche Intelligenz) «Apple Intelligence» kann mit «AI» abgekürzt werden.

Konkret ermöglicht Apples neue Sammlung an AI-Funktionalitäten das Verstehen und Erschaffen von Sprache und Bilder, und sie kann Aktionen ausführen und zwischen Apps interagieren. Speziell sei das einzigartige Verständnis für den persönlichen Kontext.

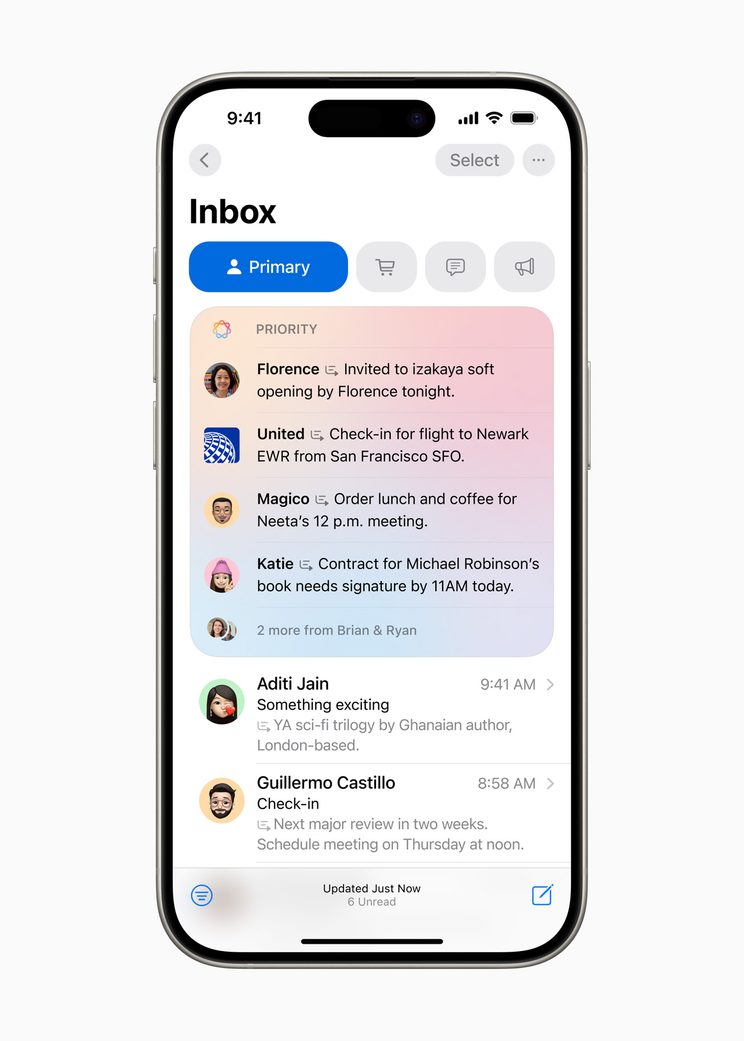

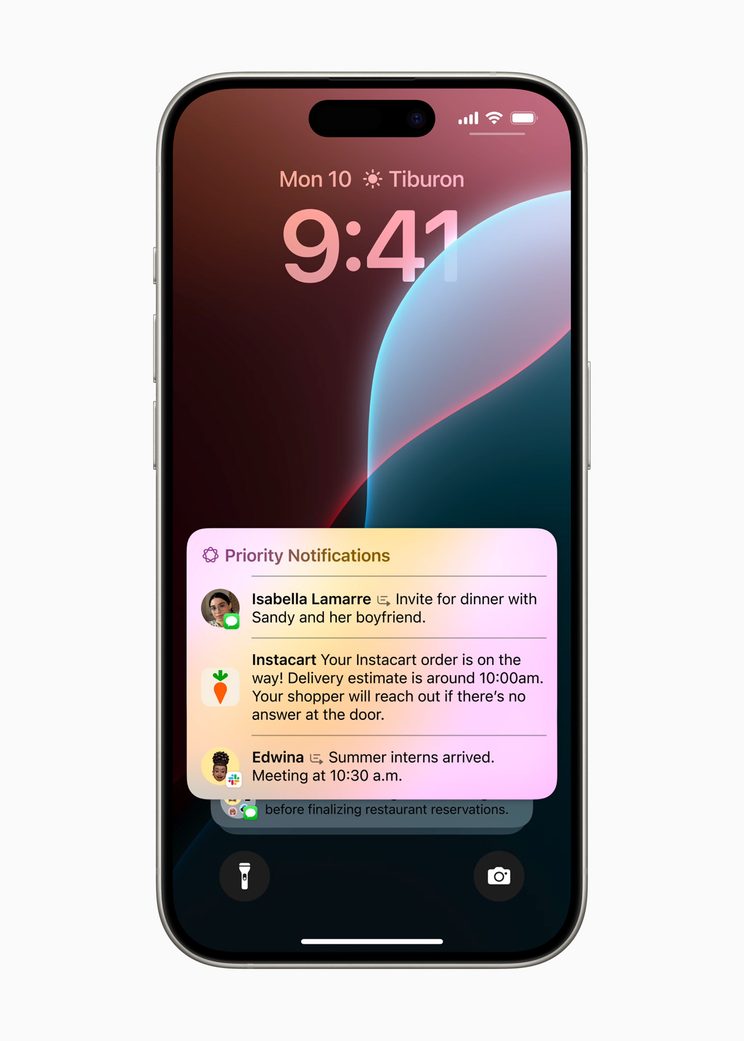

Ermöglicht wird etwa eine automatische Priorisierung von iPhone-Benachrichtigungen oder das Zusammenfassen des Inhalts einer Push-Mitteilung.

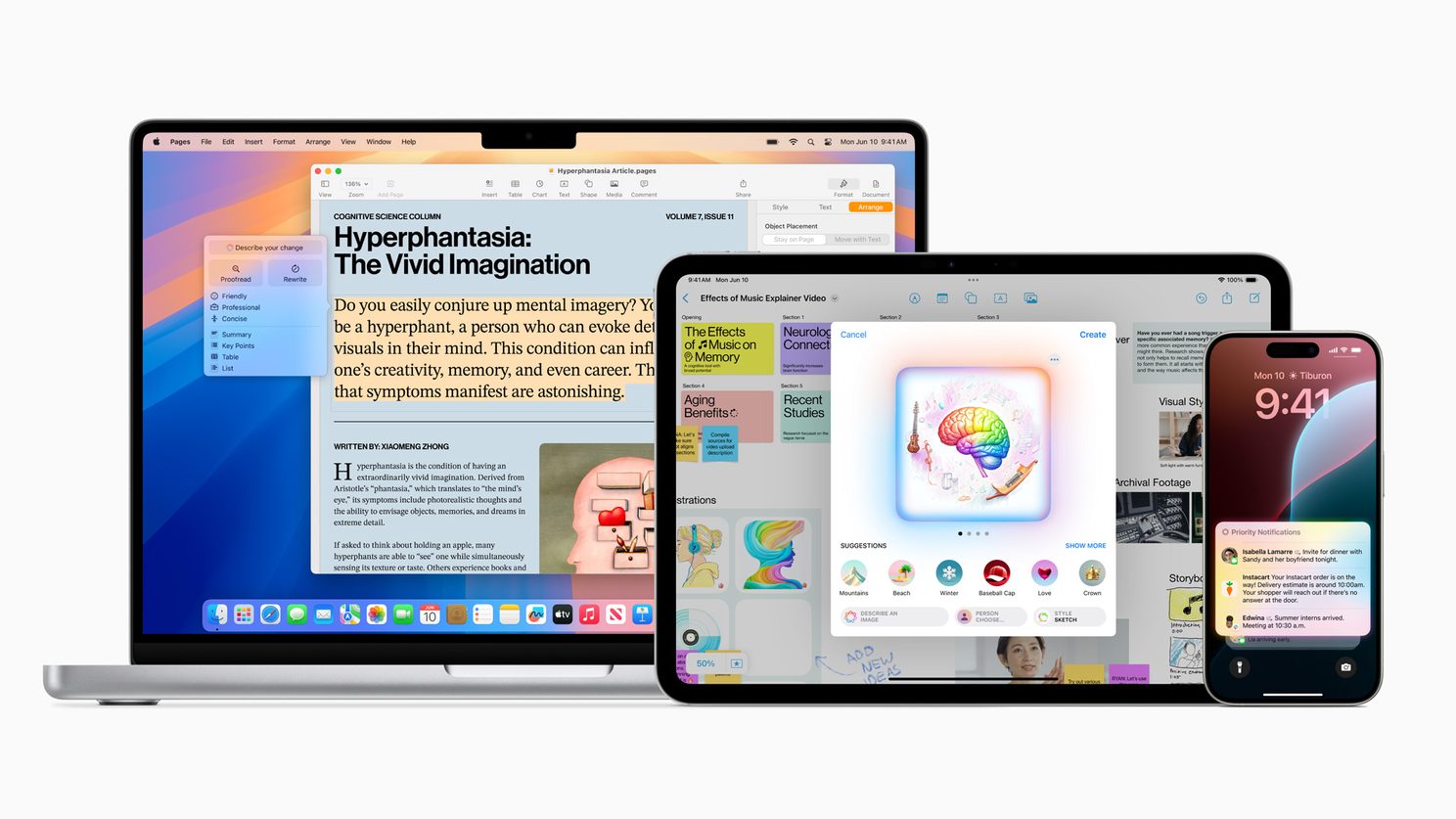

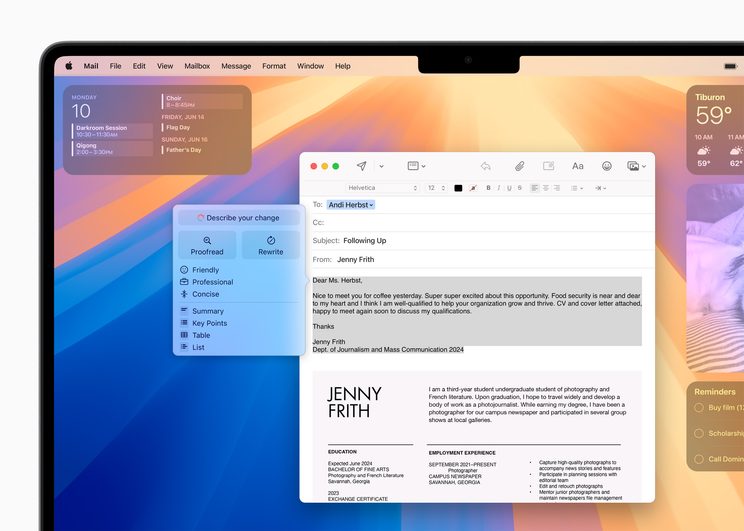

Ebenfalls zu Apple Intelligence gehören neue «Writing-Tools (Schreiben-Werkzeuge)», die system-weit eingesetzt werden können und dabei helfen, Texte Korrektur zu Lesen, Texte umzuformulieren, Texte in der Tonalität zu ändern, Zusammenfassungen zu verfassen, die wichtigsten Punkte aus Texten herauszufiltern und Geschriebenes in Tabellen- oder Listen-Form zu wandeln.

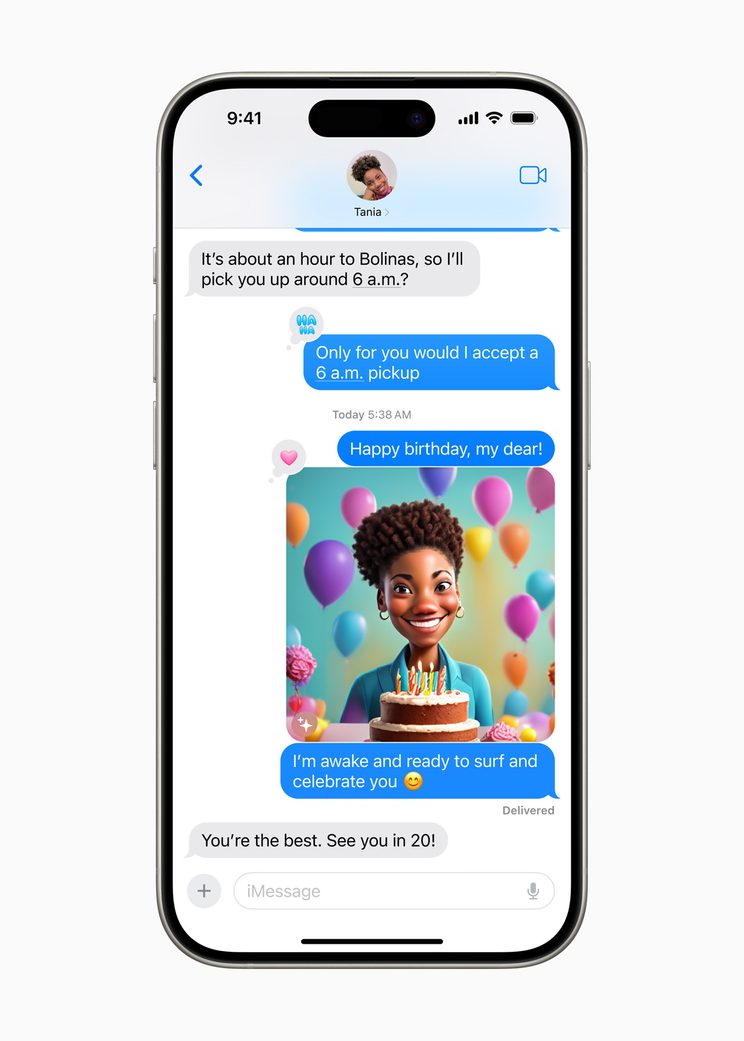

Komplett neue originäre Bilder können in einfacher Anwendung mit einer ansprechenden Benutzeroberfläche generiert werden – dabei können auch eigene Emojis kreiert oder animierte GIF erstellt werden. Das Erstellen komplett neuer Emojis nach eigenem Gusto nennt Apple «Genmoji». Da Apple Intelligence dank des «persönlichen Kontexts» auch die Personen in der eigenen Foto-Mediathek kennt, können basierend auf diesen eigenen Abbildungen erstellt werden – was die Bilder «noch persönlicher» mache, so Federighi. Erstellt werden können eigene Bilder vorerst in drei unterschiedlichen Stilen – «Sketch», «Illustration» und «Animation». Das Generieren eigener Bilder hat Apple über das ganze System hinweg in Apps wie iMessages/Nachrichten, Notes, Freeform, Keynote und Pages integriert.

Ein weiteres Anwendungsfeld von Apple Intelligence ist das Ausführen von Aktionen. Die AI-Funktionen können Aufgaben in den Apps des täglichen Gebrauchs übernehmen – einfach auf in natürlicher Sprache ausgesprochenen oder geschrieben Befehl. Als Beispiele nennt Federighi: «Zeig mir die Dateien, die Joz mir vergangene Woche geschickt hat.», «Zeige mir alle Fotos von Mutter, Olivia und mir.» oder «Spiele den Podcast, den mir meine Frau letzthin mal zugeschickt hat.» Apple Intelligence soll solche und «hunderte andere» Aufgaben über das ganze System hinweg ausführen können.

Persönlicher Kontext als Basis für Apple Intelligence

Damit diese «Personal Intelligence (persönliche Intelligenz)» überhaupt möglich ist, muss Apple Intelligence den persönlichen Kontext verstehen können. Alle neuen Funktionen basieren «auf Ihren persönlichen Informationen und Ihrem Kontext». Sie sind gemäss Federighi in der Lage, «die relevantesten Daten aus all Ihren Apps abzurufen und zu analysieren». Auch kann Apple Intelligence das auf dem Bildschirm angezeigte verstehen – so etwa eine E-Mail oder ein Kalenderereignis, welches gerade betrachtet wird.

Den Nutzen solcher Fähigkeiten demonstrierte Apples Software-Chef anlässlich der Keynote anhand des Beispiels einer Sitzung, die in den frühen Abend verschoben werden muss. Es stelle sich nun die Frage, ob diese Verschiebung der später am Abend angesetzten Theater-Aufführung der Tochter in die Quere kommen wird. Um zu helfen, soll Apple Intelligence eigenständig alle relevanten persönlichen Infos aus der Verschiebungs-E-Mail des Mitarbeiters heraus-prozessieren können. Es wird verstanden, wer die Tochter ist und wann die Aufführung stattfindet, zu welcher Sie vor geraumer Zeit einen Flyer geschickt hat; es wird verstanden, wann und wo die Sitzung stattfinden wird; und es wird die mögliche Verkehrssituation zwischen dem Büro und dem Theater prognostiziert. «Das Verständnis für solchen persönlichen Kontext ist essenziell, um wirklich nützliche Intelligenz anzubieten», so Federighi.

All das müsse indes «richtig gemacht» werden. Federighi ist überzeugt, dass für eine solche Intelligenz nicht alle Daten aus dem eigenen Leben an jemanden übergeben werden müssen, um «in einer AI-Cloud von irgendwem» gespeichert und analysiert zu werden. Apple Intelligence funktioniere unter Einhaltung höchstem Schutz der Privatsphäre: «Starke Intelligenz geht Hand in Hand mit starkem Datenschutz.»

Datenschutz und Privatsphäre

Der Architektur des Systems liegt der Datenschutz zugrunde, so Federighi. Der Eckpfeiler von Apple Intelligence sei On-Device Processing, also die Verarbeitung direkt auf dem persönlichen Gerät.

Apple Intelligence sei tief in die Systeme des Mac, iPad und iPhone und die Apps darauf integriert – dabei habe es «Kenntnis Ihrer persönlichen Daten, ohne die persönlichen Daten zu sammeln». Möglich sei dies nur durch Apples einzigartige Integration von Hardware und Software, sowie Apples jahrelangen Investitionen in die Entwicklung von fortschrittlichen Chips für «On-device Intelligence». Tief-integrierte Generative Modelle benötigen eine immense Rechenleistung – die fortschrittlichsten Apple-Chips wie der A17 Pro und die M-Chip-Familie (M1, M2, M3 und M4) würden ebendiese rechnerische Grundlage bieten, um Apple Intelligence betreiben zu können.

Das Apple Intelligence zugrundeliegende «persönliche Intelligenz-System» bestehe aus hochleistungsfähigen grossen Sprach- und Diffusions-Modellen, die auf die persönlichen alltäglichen Aufgaben spezialisiert sind und sich sofort an die aktuelle persönliche Tätigkeit anpassen können. Ebenfalls Teil des Systems ist ein «On-Device Semantic Index», welcher Informationen aus verschiedenen Apps erkennen und organisieren kann. Wenn eine Anfrage an Apple Intelligence gestellt wird, wird dieser semantische Index benutzt, um den generativen Modellen relevante persönliche Daten zur Verfügung zu stellen, damit diese den persönlichen Kontext haben, um die Aufgabe erledigen zu können.

Die meisten dieser Modelle laufen komplett auf dem persönlichen Gerät (On-Device), ein paar seien indes «grösser, als was heutzutage in einen Hosensack passt». Server können hier Abhilfe schaffen. Traditionell, so Federighi, können Server diese persönlichen Daten speichern, ohne dass dies aktiv bemerkt wird – und die Daten danach in nicht beabsichtigte Art und Weise weiterverwenden. Weiter sei die auf den Servern laufende Software nur durch die Besitzenden der Geräte einsehbar – was es unmögliche mache zu verifizieren, dass mit den Daten nichts gemacht wird, was von der nutzenden Person nicht beabsichtigt war. Anders sei es bei Apple-Geräten wie dem iPhone, beteuert Federighi. Wer ein iPhone nutzt, ist selbst in Kontrolle über die eigenen Daten – «wo sie gespeichert werden und wer auf sie zugreifen kann». Auch sei das Software-Image für das iPhone zugänglich für unabhängige Experten, welche fortlaufend die Privatsphäre verifizieren können.

Sichere Apple-Server: «Private Cloud Compute»

Ebendiese Privatsphäre und Sicherheit möchte Apple nun auf die Cloud erweitern – und hat dazu eigene Server mit Apple-eigenen Chips (Apple Silicon) entwickelt: «Private Cloud Compute» nennt dies Apple. Diese Cloud resp. Apple-Server ermöglichen die Ausführung komplexer «Apple Intelligence»-Anfragen, die On-Device (noch) nicht möglich sind. Sie bieten die gleiche Sicherheit und Privatsphäre wie ein iPhone – vom Chip her, über die Sicherheits-Properties der Swift-Programmiersprache bis zu «Software mit integrierter Transparenz».

Wenn eine Anfrage an Apple Intelligence gemacht wird, analysiert das System, ob die Anfrage On-Device oder über die sichere Apple-Cloud abgearbeitet werden kann. Sobald grössere Computerleistung gebraucht wird, kann das System «Private Cloud Compute» anzapfen und schickt den Apple-Servern einzig jene Daten, die relevant für das Erledigen der Anfrage sind. Die Daten werden gemäss Federighi dabei nie auf den Servern abgespeichert noch seien sie für Apple zugänglich – sie sollen «exklusiv für das Erfüllen der Aufgabe» genutzt werden. Wie beim iPhone sollen auch bei der Apple-Cloud unabhängige Experten die darauf laufende Software auf deren Sicherheit und Datenschutz inspizieren können. Federighi doppelt nach, dass Private Cloud Compute kryptografisch sicherstelle, dass ein iPhone, iPad und Mac sich weigere, mit einem Server zu kommunizieren, es sei denn, dessen Software wurde zur Überprüfung öffentlich protokolliert. Dies setzte einen «brandneuen Standard für den AI-Datenschutz», wie Federighi weiter ausführt, und es «erschliesse eine künstliche Intelligenz, der vertraut werden kann».

Viele Apple-Intelligence-basierte Funktionen

Neben den oben bereits erwähnten neuen Funktionen haben anlässlich der Keynote verschiedene Apple-Mitarbeitende eine Vielzahl an weiteren Funktionen demonstriert, die Apple Intelligence in macOS 15 «Sequoia», iPadOS 18 und iOS 18 neu bieten wird.

So wird allen voran Siri mit den neuen Systemen in einem neuen Design daher kommen. Auf dem iPhone zeigt sich eine aktive Siri neu darin, dass der ganze Bildschirm in ein farbiges Leuchten gefasst ist. Weiter kann jederzeit einfach durch ein Doppel-Tippen des unteren Bildschirm-Endes eine Anfrage an Siri getippt statt gesprochen werden.

Mit Siri kann nun endlich auch natürlicher gesprochen werden – während dem Sprechen können Befehle neu sogar direkt korrigiert werden – und der Assistent versteht endlich den Gesprächskontext, also muss nicht ständig alles wiederholt werden, wenn auf einen vorhergehenden Befehl aufgebaut werden soll.

Siri wird ausserdem mit grossem Wissen über Apple-Produkte ausgestattet und soll künftig auch Auskunft geben können darüber, wie etwa gewisse Funktionen genutzt werden können – auch wenn der Name der Funktion nicht bekannt ist, dann soll sie auch einfach umschrieben werden können.

In «Mail» können E-Mails neu statt mit den ersten paar Inhalt-Zeilen mit einer nützlichen Inhalts-Zusammenfassung aufgelistet werden. Ebendies gilt auch für Push-Nachrichten auf dem Lock-Screen oder in der Mitteilungszentrale.

Ein neuer Fokus namens «Unterbrechungen reduzieren» analysiert den Inhalt einkommender Mitteilungen und lässt nur jene «durch», die wirklich wichtige Informationen enthalten.

Mit «Image Playground» steht das oben erwähnte AI-gestützte Generieren von eigenen Bildern nicht nur system-weit innerhalb von Apps zur Nutzung zur Verfügung, sondern die Bild-Generierung ist auch als eigenständige App verfügbar – damit die Kreationen an noch mehr Orten eingesetzt werden können.

In der «Notizen»-App kann mit dem neuen «Image Wand (Bilder-Zauberstab)» eine grobe Skizze in ein Apple-Intelligence-generiertes Bild verwandelt werden. Auch können Leerflächen automatisch mit einer Darstellung gefüllt werden, die zum umliegenden Text passt.

Ein «Clean Up»-Werkzeug in der Fotos-App erlaubt das einfache und schnelle Entfernen von nicht gewünschten Objekten in einer Aufnahme. Die Suche in der Foto-Apps wird ausserdem mit natürlich formulierten Suchanfragen noch mächtiger. Und neu können auch eigene Memories- resp. Erinnerungen-Videos in Fotos sehr einfach mithilfe von Apple Intelligence erstellt werden.

«AI mit Weltwissen» dank ChatGPT-Integration

Dass es bereits verschiedene AI-Tools gibt, die für gewisse Aufgaben sehr nützlich sein können, bestreitet Apple nicht. Besonders jene, die «auf das Wissen der Welt zurückgreifen oder spezielle Fähigkeiten in einem bestimmten Bereich bieten», können immens wertvoll sein, so Federighi. «Wir möchten, dass diese externen Modelle genutzt werden können, ohne zwischen verschiedenen Tools wechseln zu müssen» – deshalb integriert Apple diese direkt in die Systeme. Den Anfang macht «das Beste aller Modelle»: «ChatGPT» von OpenAI.

In Siri wird Unterstützung für ChatGPT eingebaut. Die digitale Assistentin kann auf das Wissen von ChatGPT (4.0) zurückgreifen, wenn es möglicherweise nützlich für das Erledigen des gestellten Befehls ist. Siri erkennt von selbst, wenn die Anfrage möglicherweise von ChatGPT erledigt werden kann und sendet die Anfrage nur dann zum Modell, wenn dies auch ausdrücklich bestätigt wird. Das gilt für gesprochene oder geschriebene Befehle, es können aber via Siri auch Fotos, PDF, Präsentationen oder andere Dokumente für Anfragen an ChatGPT geschickt werden.

ChatGPT ist auch in die oben genannten system-weiten Writing-Tools integriert. Mit «Compose» lassen sich so beliebige Inhalte generieren – Geschriebenes oder auch Bilder.

Die ChatGPT-Funktionalitäten sind über Apple Intelligence komplett kostenlos zugänglich – und ohne dass dazu bei OpenAI ein Konto erstellt werden muss. Wie Federighi sagt, würden die Anfragen und Informationen bei ChatGPT nicht geloggt. ChatGPT wird immer nur nach ausdrücklicher Bestätigung durch Apple Intelligence verwendet. Wer möchte, kann auch sein persönliches Konto verknüpfen und die Funktionen darüber verwenden. Auch sind so die erweiterten Fähigkeiten der zahlungspflichtigen ChatGPT-Variante verfügbar. Allem Anschein nach wird die ChatGPT-Integration erst mit einem Update für macOS 15, iPadOS 18 und iOS 18 lanciert – Federighi verspricht sie aber für «later this year (später in diesem Jahr)».

Andere AI-Modelle als ChatGPT will Apple «in Zukunft» integrieren.

Verfügbar ab Herbst

Apple Intelligence ist Teil von macOS 15 «Sequoia», iPadOS 18 und iOS 18. Die neuen Betriebssystem-Generationen werden im Herbst 2024 veröffentlicht. Apple Intelligence wird zum Start als eine «Beta» verfügbar sein.

Ab CHF 5.– im Monat

👉🏼 Wir benötigen deine Unterstützung! Unterstütze macprime mit einem freiwilligen Gönner-Abo und mache die Zukunft unseres unabhängigen Apple-Mediums aus der Schweiz mit möglich.